-

-

Oracle JDK 1.8

-

Hadoop 3.2.4

-

Flink 1.14.0

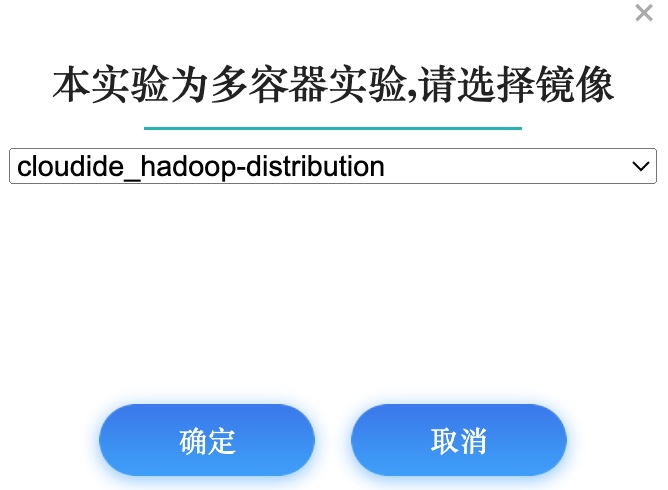

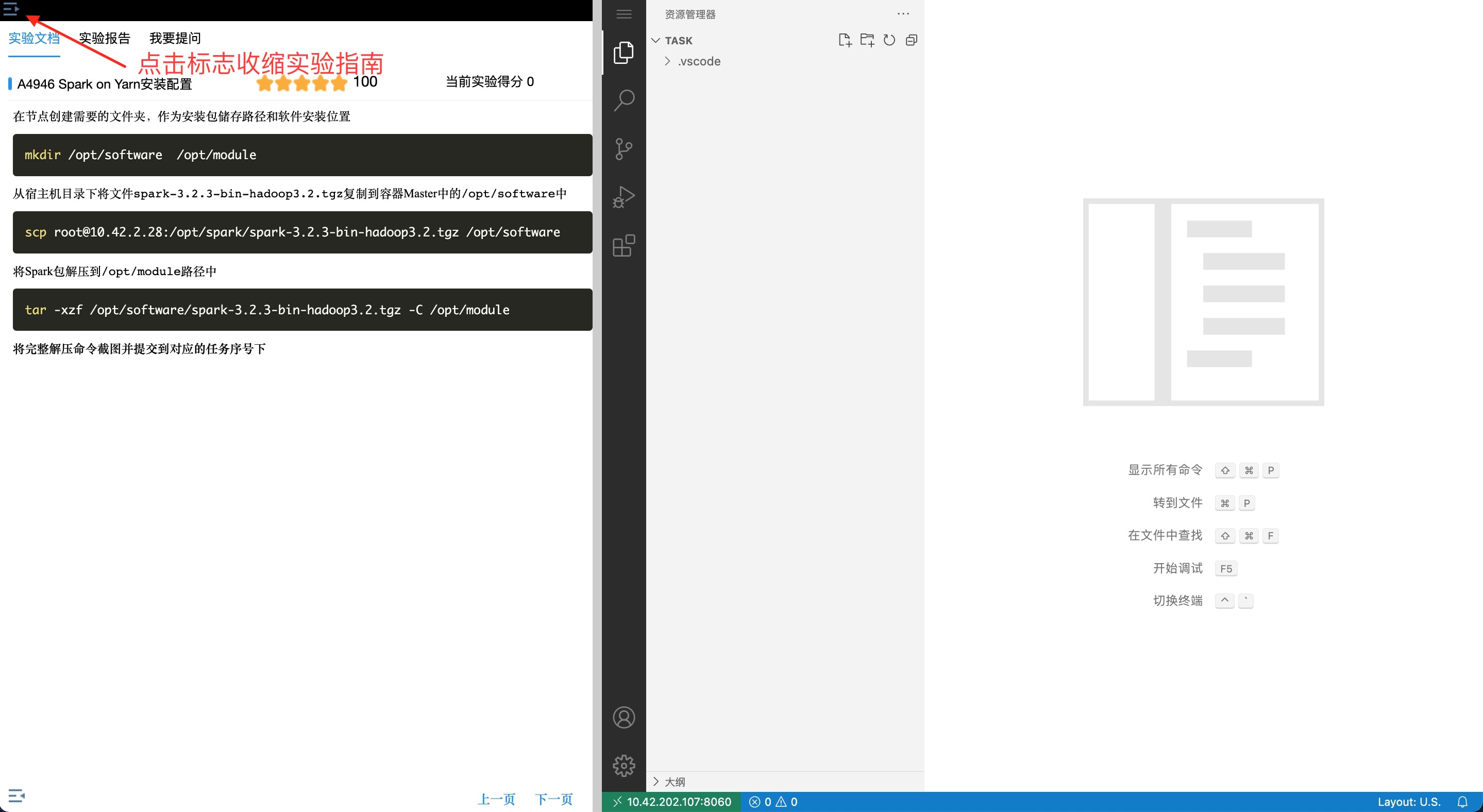

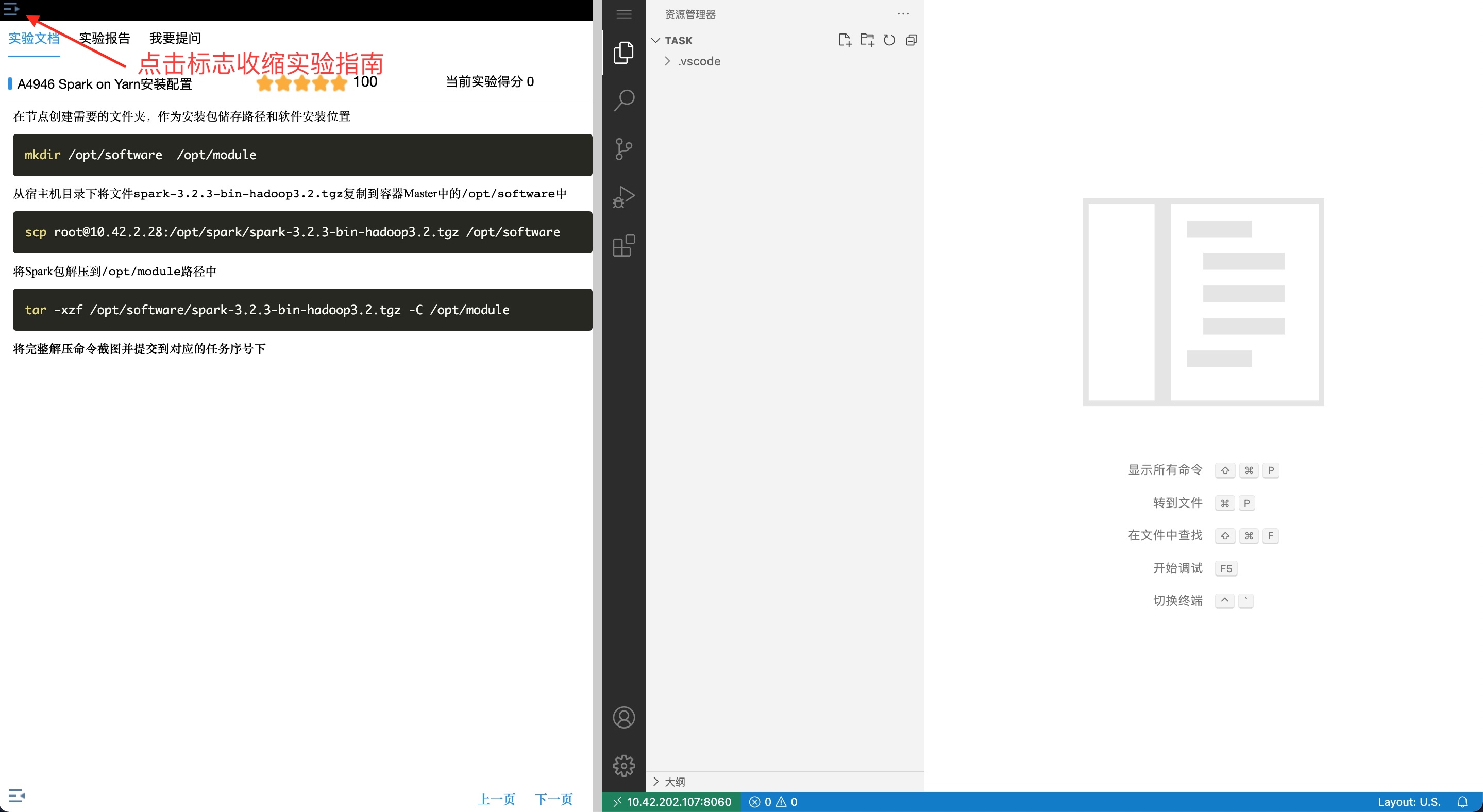

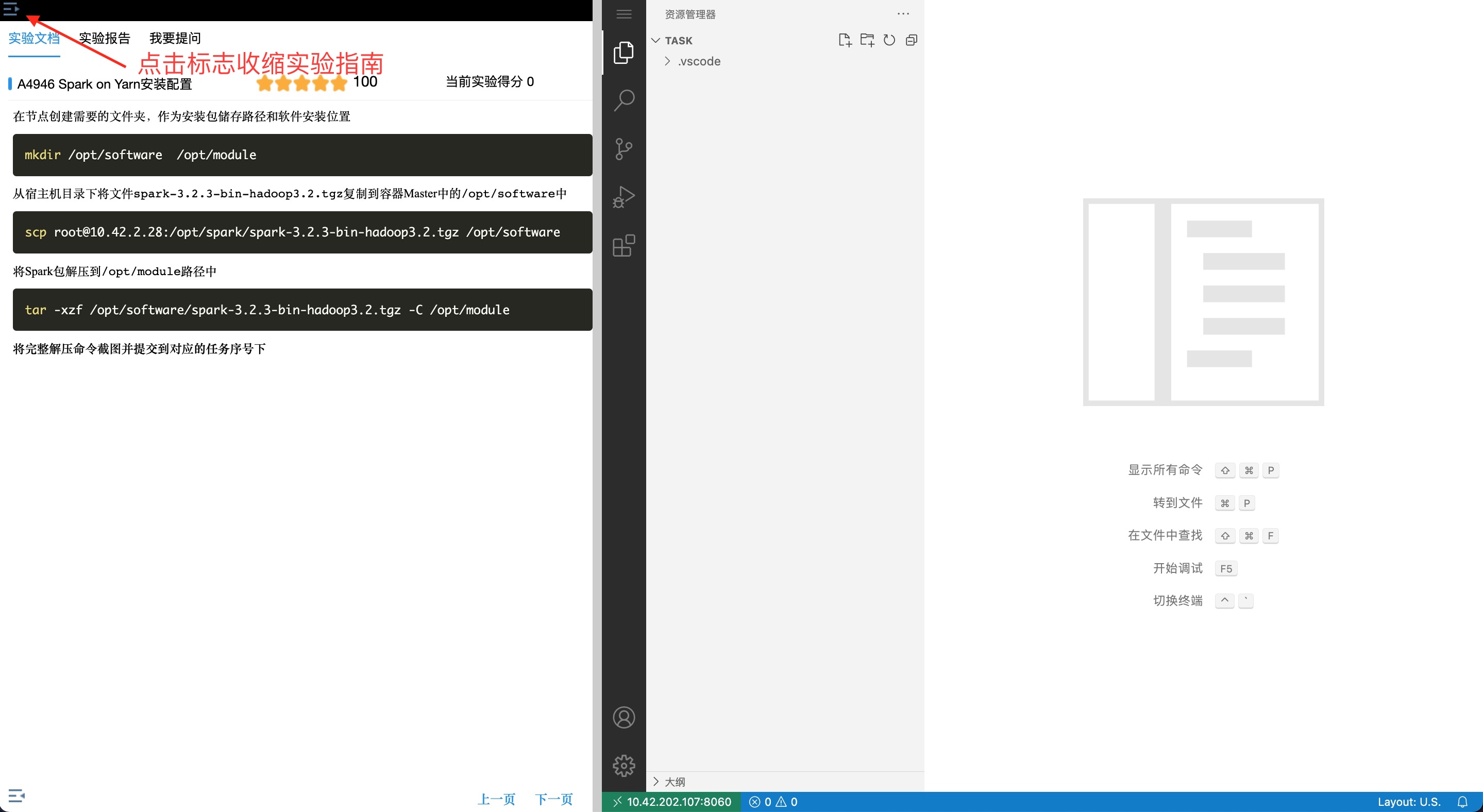

1、 点击开始实验按钮,打开当前实验所有镜像环境  2、 进入实验环境后, 点击左上角收缩实验指南

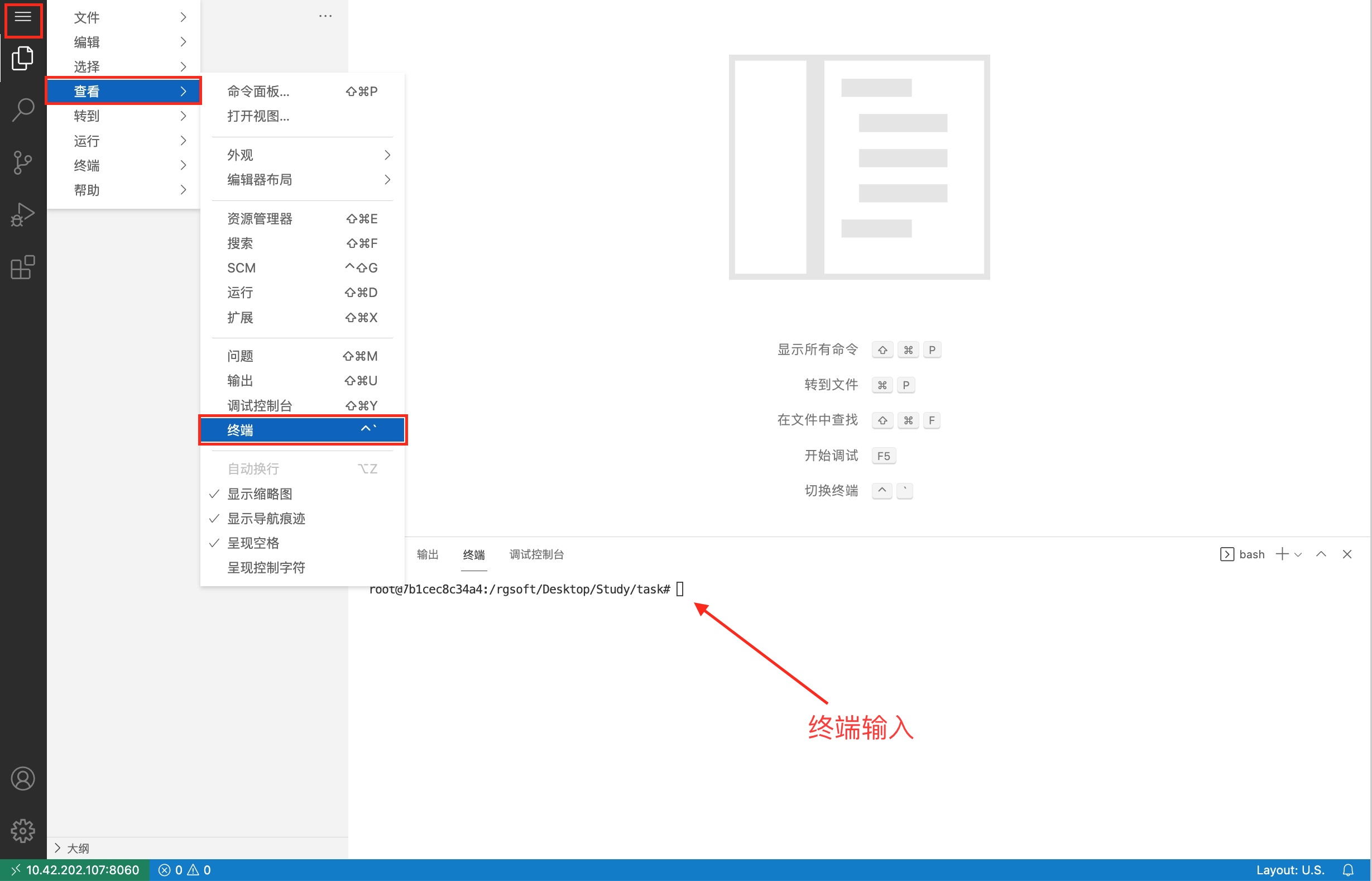

2、 进入实验环境后, 点击左上角收缩实验指南  3、 点击环境左上角的“三个横线”的标志,如下图。 最后点击“终端”。

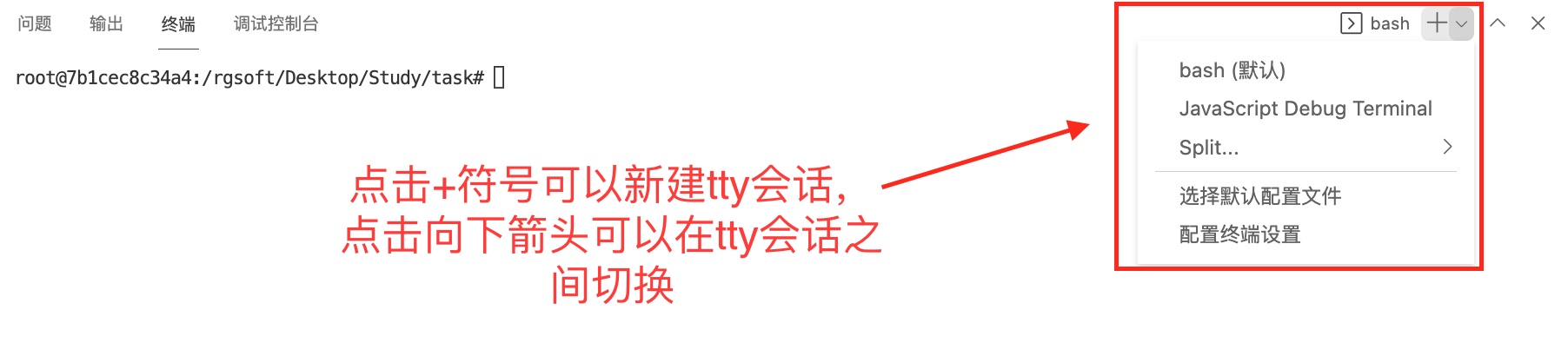

3、 点击环境左上角的“三个横线”的标志,如下图。 最后点击“终端”。  4、 会在右下方看到打开的终端,可直接在终端中进行操作。

4、 会在右下方看到打开的终端,可直接在终端中进行操作。

配置节点hosts解析

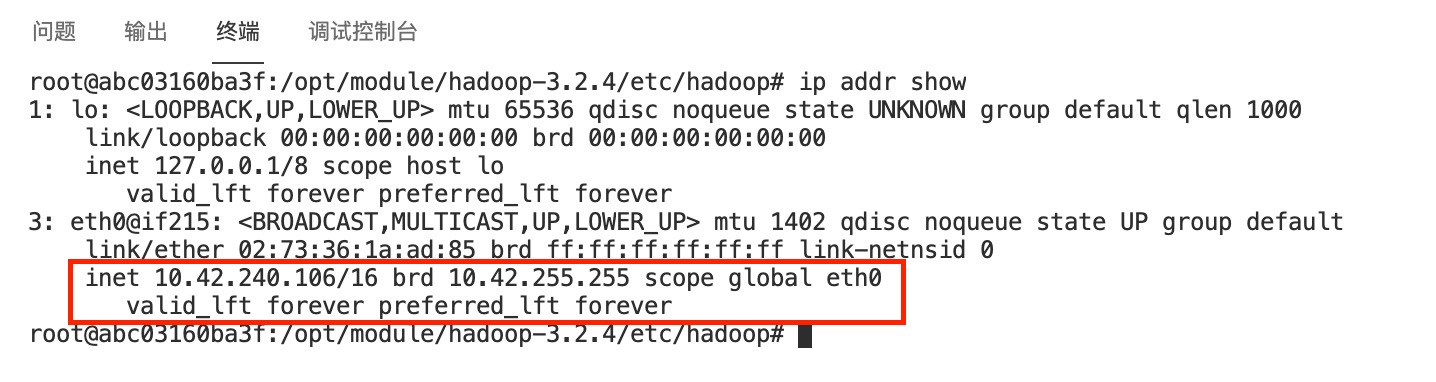

使用命令查看自己所有节点环境的IP信息:

ip addr show

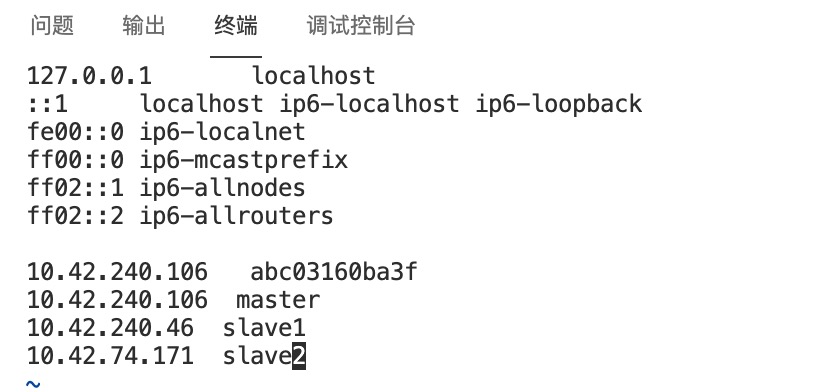

把所有节点的IP记录下来,将三个节点分别命名为master、slave1、slave2,取1个IP作为master节点,其余做slave节点。 修改容器中

把所有节点的IP记录下来,将三个节点分别命名为master、slave1、slave2,取1个IP作为master节点,其余做slave节点。 修改容器中/etc/hosts文件,根据自己的节点的IP信息,在文件末添加类似下面的内容:

下面IP仅供参考,以自己环境的实际IP为准

10.42.240.106 master

10.42.240.46 slave1

10.42.74.171 slave2

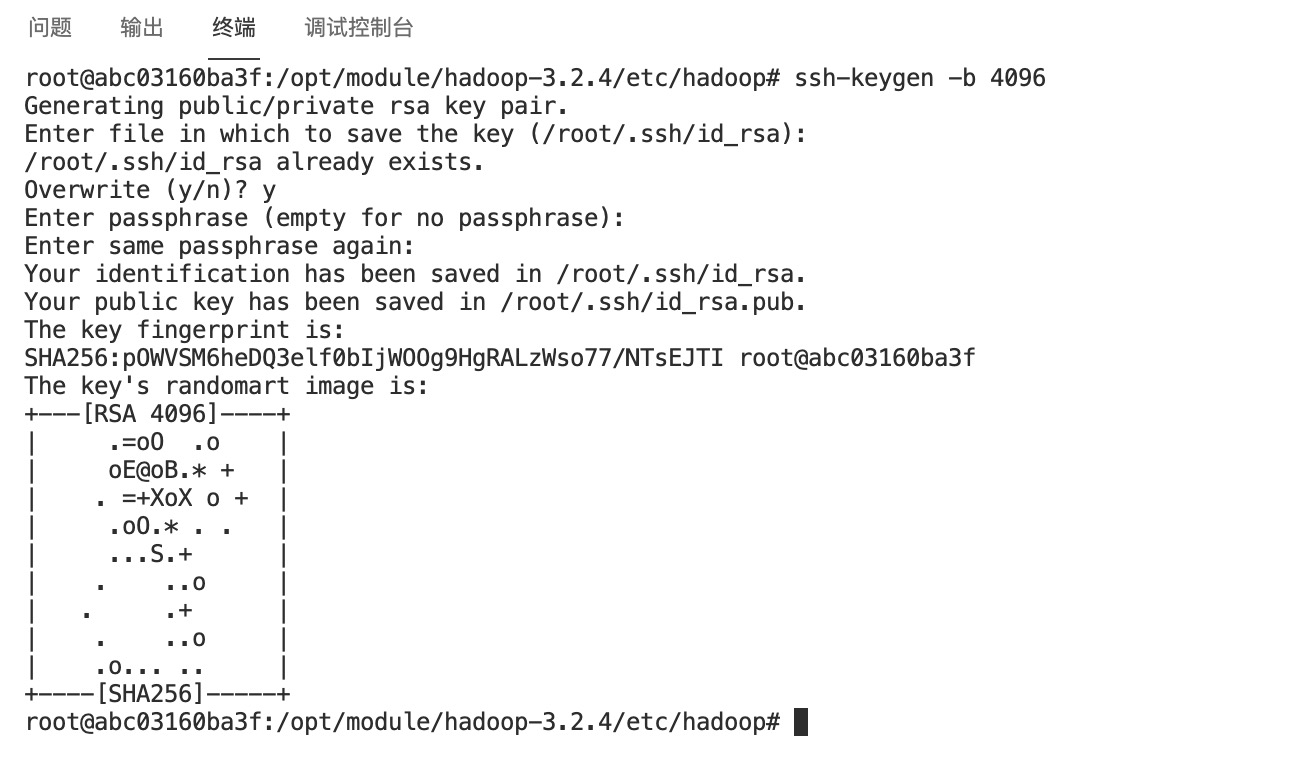

配置及节点ssh免密登录

在master节点使用命令生成key,需要填入的内容直接留空即可

ssh-keygen -b 4096

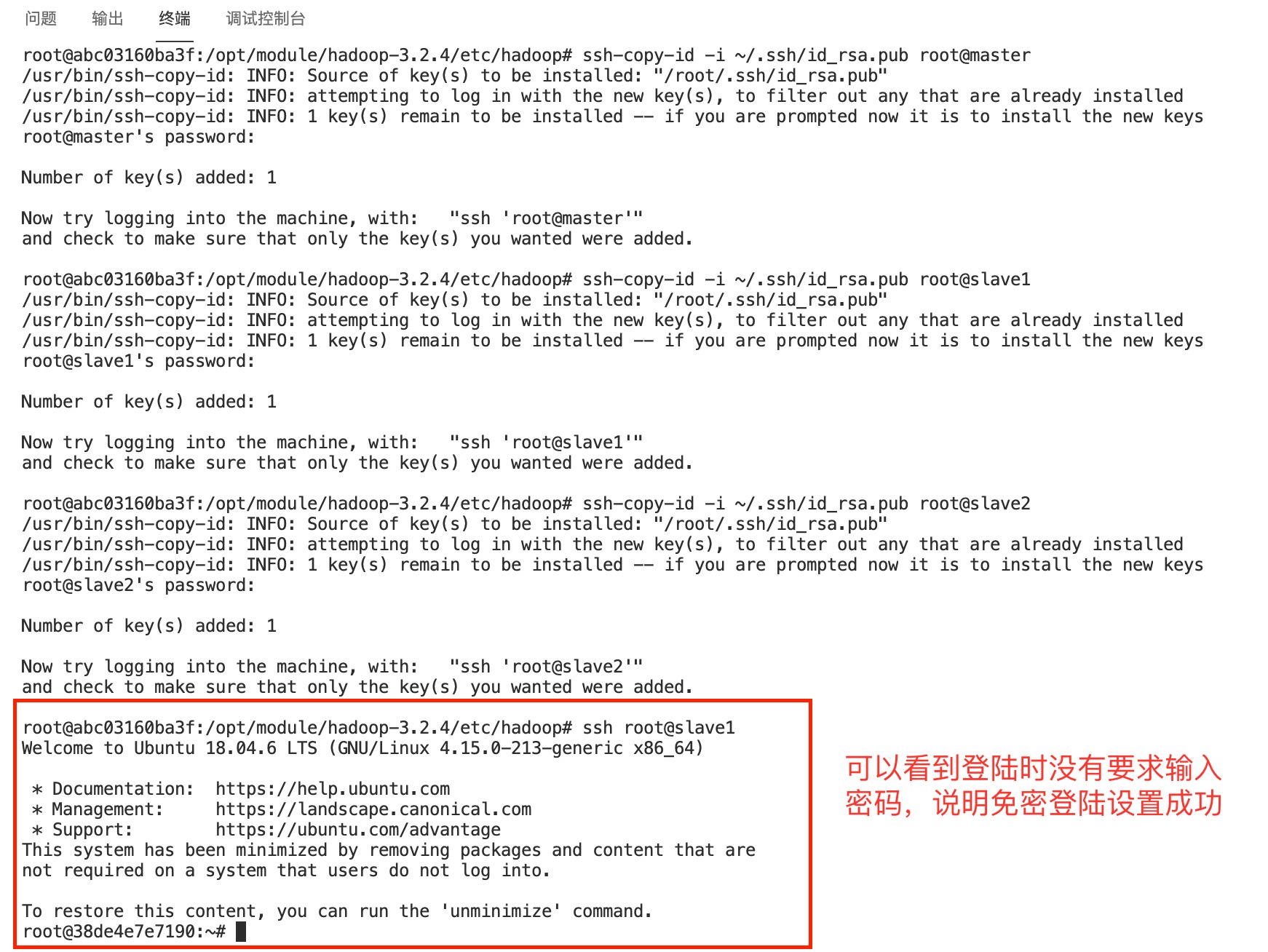

使用下面的命令把master节点的公钥拷贝到包括master节点的所有的节点,默认密码为

使用下面的命令把master节点的公钥拷贝到包括master节点的所有的节点,默认密码为root

ssh-copy-id -i ~/.ssh/id_rsa.pub root@master

ssh-copy-id -i ~/.ssh/id_rsa.pub root@slave1

ssh-copy-id -i ~/.ssh/id_rsa.pub root@slave2

使用ssh登录成功后后,可使用 exit 命令退出ssh会话回到原先节点终端继续操作

exit

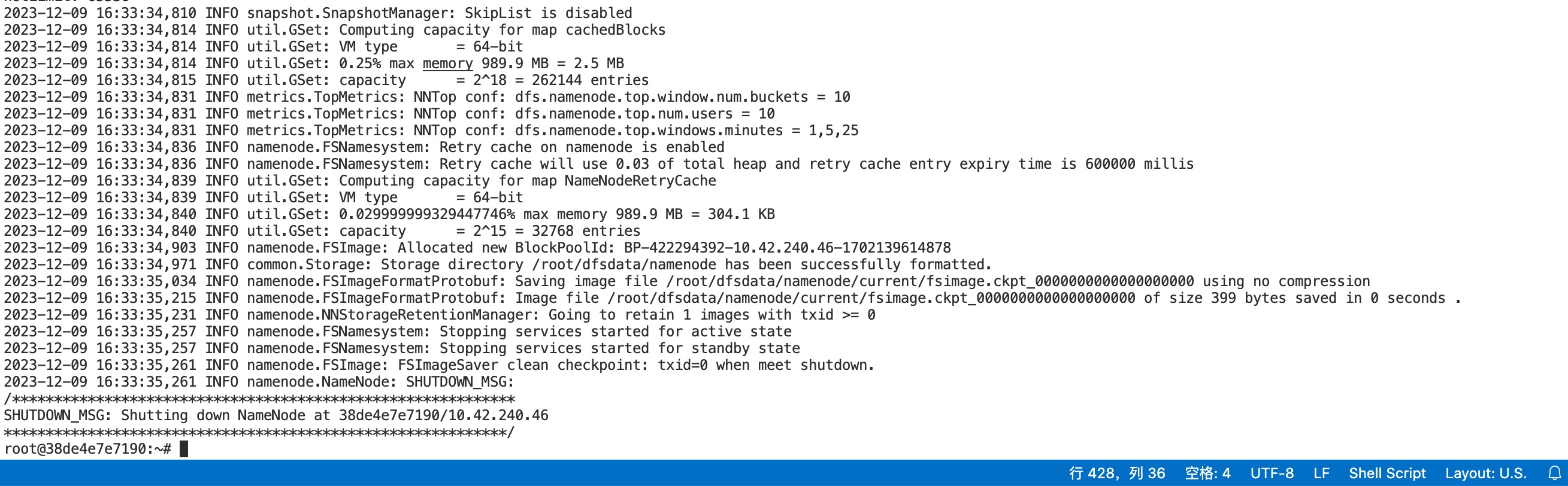

最后,在master节点的终端使用下面的命令初始化Hadoop环境namenode

hdfs namenode -format

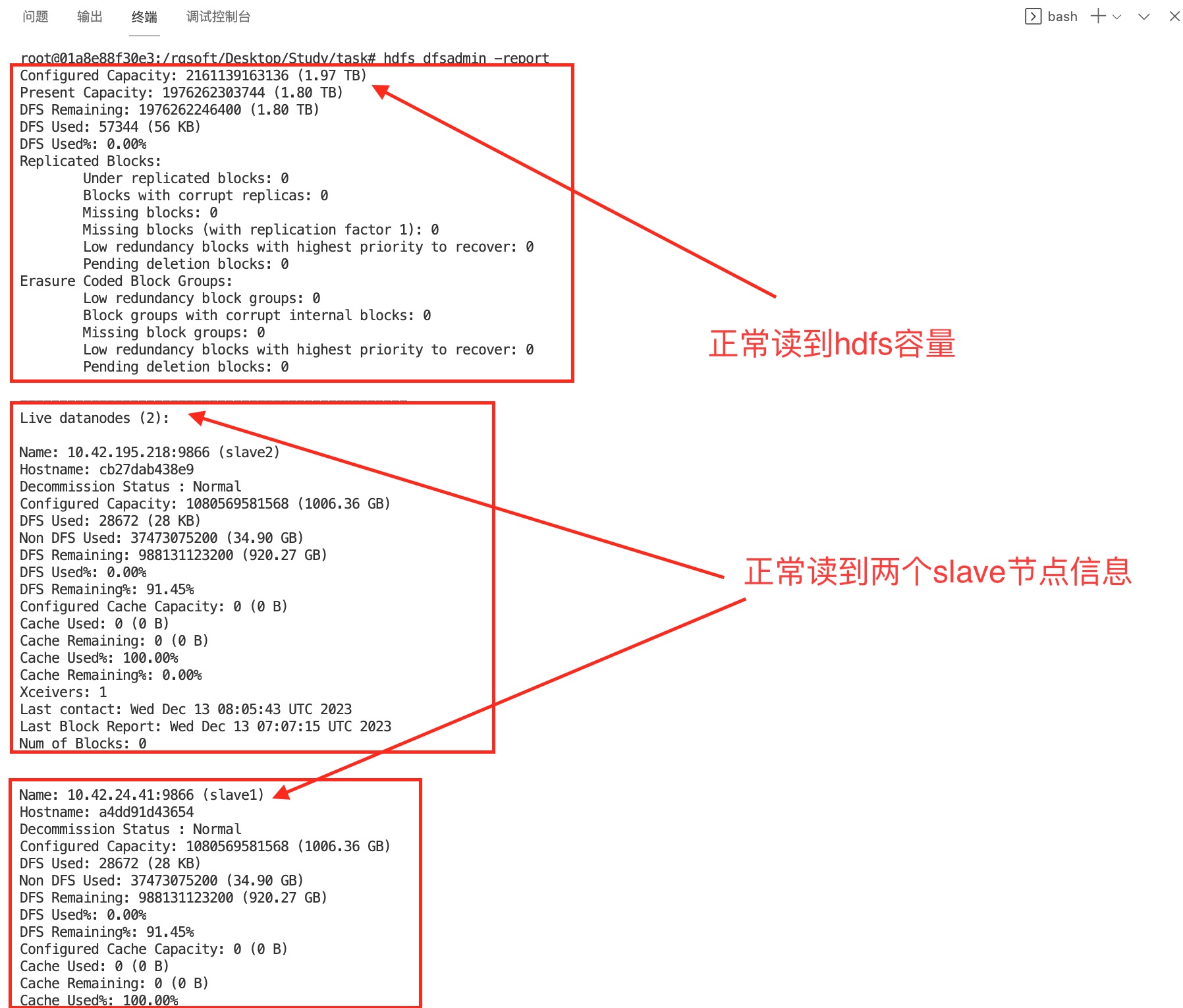

确保Hadoop启动并正常运行。

# hadoop的集群启动命令为:

start-all.sh

# 启动后检查是否安装成功:

hdfs dfsadmin -report

在节点创建需要的文件夹,作为安装包储存路径和软件安装位置

mkdir /opt/software /opt/module

从宿主机目录下将文件flink-1.14.0-bin-scala_2.12.tgz复制到容器Master中的/opt/software路径中。

scp root@10.42.2.28:/opt/flink/flink-1.14.0-bin-scala_2.12.tgz /opt/software

将Master节点Flume安装包解压到/opt/module路径中:

tar -xzf /opt/software/flink-1.14.0-bin-scala_2.12.tgz -C /opt/module

将解压命令截图并提交到对应的任务序号下

修改节点环境中的/etc/profile文件,在文件末添加下面的内容:

# 添加flink的环境变量

export FLINK_HOME=/opt/module/flink-1.14.0

export PATH=$PATH:$FLINK_HOME/bin

执行下面的命令使添加的环境变量生效:

source /etc/profile

在终端里运行命令flink --version

flink --version

将命令与结果截图并提交到对应的任务序号下

在yarn上以per job模式(即Job分离模式,不采用Session模式)运行 $FLINK_HOME/examples/batch/WordCount.jar 在终端里运行下面的代码:

export HADOOP_CLASSPATH=`hadoop classpath`

flink run -m yarn-cluster -p 2 -yjm 2G -ytm 2G $FLINK_HOME/examples/batch/WordCount.jar

1 本站一切资源不代表本站立场,并不代表本站赞同其观点和对其真实性负责。

2 本站一律禁止以任何方式发布或转载任何违法的相关信息,访客发现请向站长举报

3 本站资源大多存储在云盘,如发现链接失效,请联系我们我们会第一时间更新。

暂无评论内容